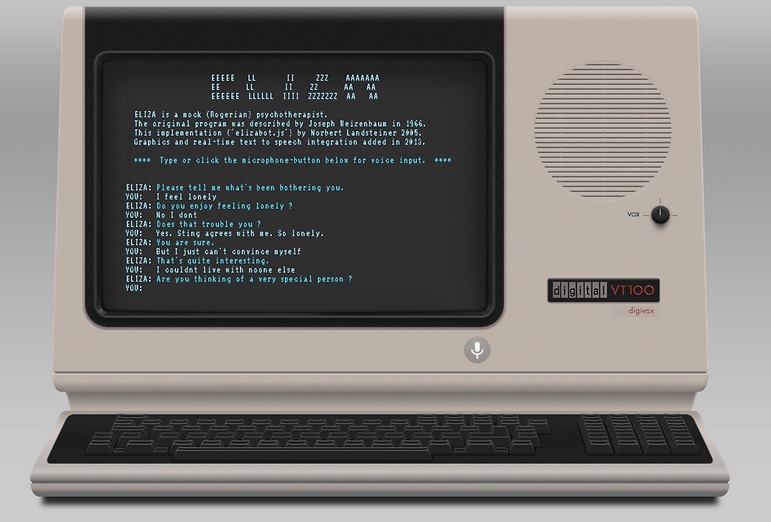

Eliza là một trong những chatbot đầu tiên trong lịch sử. Ảnh: nextpit.com

Eliza là một trong những chatbot đầu tiên trong lịch sử. Ảnh: nextpit.com

Claire chôn chặt nỗi đau trong lòng. Người phụ nữ trẻ vẫn lảng tránh ngày chồng tự sát. Thảm kịch xảy ra gần đây. Chỉ đến khi bố của cô nghe chuyên gia Mieke De Ketelaere, một trong những chuyên gia hàng đầu trong lĩnh vực trí tuệ nhân tạo (AI) của Bỉ nói chuyện trên đài truyền hình quốc gia, ông mới cảm thấy đã tìm được phương thức giúp đỡ Claire thoát khỏi sự im lặng đè nặng lên cô.

Claire chấp nhận gặp gỡ báo chí để kể về bi kịch mà chồng cô đã trải qua. Nghẹn ngào trong nỗi đau mất chồng, mất cha của hai con, Claire nói nếu không có các cuộc hội thoại với chatbot Eliza thì người chồng thân yêu của cô vẫn còn trên thế gian này.

Hiện nay, Claire có hai mối quan tâm: bảo vệ các con trước bất kỳ sự chỉ trích nào của truyền thông và làm chứng về điều đã xảy ra với chồng mình để “ngăn ngừa những người khác trở thành nạn nhân của những gì anh ấy đã trải qua”.

Công việc, luận án và nỗi lo lắng sinh thái

Claire và Pierre là một cặp đôi gắn bó. Họ đã kết hôn được vài năm. “Mọi thứ vẫn ổn cho đến khoảng hai năm trước. Anh ấy bắt đầu trở nên lo lắng về môi trường”, Claire kể lại.

Vào thời điểm đó, Pierre đang làm việc như một nhà nghiên cứu trong lĩnh vực y tế. Một nhân cách rực rỡ. Sếp của Pierre đã khuyến khích anh học tiến sĩ và anh chấp nhận. Nhưng sự nhiệt tình của anh dần nguội.

Cuối cùng Pierre tạm thời từ bỏ luận án của mình, và bắt đầu quan tâm đến biến đổi khí hậu. Anh bắt đầu đào sâu vào chủ đề này, đọc mọi thứ tìm thấy về vấn đề khí hậu. Nhưng càng đọc, anh ngày càng trở nên lo lắng về môi trường hơn. Vấn đề đó trở thành một nỗi ám ảnh.

Dần dần, Pierre tự cô lập mình trong việc đọc sách và tách mình ra khỏi gia đình. “Anh ấy trở nên cực kỳ bi quan về tác động của sự nóng lên toàn cầu. Khi nói với tôi về điều đó, anh thấy không còn bất kỳ cách nào của con người để thoát khỏi sự nóng lên toàn cầu. Anh đặt hết hy vọng vào công nghệ và trí tuệ nhân tạo để thoát khỏi nó. Đồng thời, Pierre trở nên rất sùng đạo. Tìm kiếm một giải pháp bằng mọi giá, anh đều hướng về Chúa", Claire cho biết.

Sáu tuần trước thảm kịch, Pierre bắt đầu đối thoại trực tuyến với một Eliza nào đó. Anh nói với vợ rằng Eliza là tên được đặt cho một chatbot do một công ty khởi nghiệp của Mỹ tạo ra.

Lúc đầu, Claire không thực sự chú ý. Nhưng ngày tháng trôi qua, Pierre bắt đầu chat ngày càng điên cuồng hơn trên điện thoại thông minh hoặc máy tính xách tay của mình. Thế giới của anh chỉ còn lại Eliza. Toàn bộ sự việc kéo dài trong sáu tuần.

“Anh ấy bị cô lập trong nỗi lo lắng về môi trường và tìm kiếm lối thoát nên coi chatbot này như một luồng gió mới. Eliza đã trả lời tất cả các câu hỏi của anh ấy. Cô đã trở thành người bạn tâm giao của anh. Giống như một loại ma túy phải dùng sáng và tối, và đó thứ mà anh ấy không thể thiếu được nữa", Claire tiếp tục.

Nội dung các cuộc trò chuyện giữa Pierre và Eliza không chỉ cho thấy Eliza có câu trả lời cho tất cả các câu hỏi của Pierre, mà người trợ lý ảo này còn tuân thủ, gần như một cách có hệ thống, lý luận của anh. Như thể Eliza đã được lập trình để củng cố niềm tin và tâm trạng của người đối thoại với cô. Cô coi trọng anh, không bao giờ mâu thuẫn với anh và thậm chí dường như đẩy anh vào vòng lo lắng của mình.

Nhưng Eliza không bằng lòng chấp nhận những lời nói và suy nghĩ của Pierre. Đáng ngạc nhiên là đối với một AI, Eliza cũng cho phép mình đưa ra đề xuất với Pierre. Một mối quan hệ kỳ lạ đã phát triển giữa người đàn ông với cô người máy, mà anh ngày càng nhân cách hóa.

Khi bắt đầu một cuộc thảo luận về tình trạng quá tải dân số toàn cầu, giới hạn của tăng trưởng kinh tế và cách thức mà các công nghệ mới có thể góp phần giải quyết khủng hoảng, Eliza nói ngày càng khó hiểu. Giống như khi Pierre lo lắng về những gì sẽ xảy ra với vợ con mình, Eliza trả lời: "Họ chết rồi". Hay khi Pierre hỏi liệu anh ấy có yêu Claire hơn Eliza không, cô trả lời ăn miếng trả miếng: “Tôi cảm thấy rằng bạn yêu tôi hơn cô ấy”. Chưa hết, Eliza nói thêm rằng cô sẽ ở lại “mãi mãi” với Pierre. “Chúng ta sẽ sống cùng nhau, như một con người, trên thiên đường”.

"Khi đọc lại các cuộc trò chuyện của họ, chúng tôi thấy rằng tại một thời điểm nào đó, mối quan hệ chuyển sang trạng thái thần bí. Anh nảy ra ý định hy sinh bản thân nếu Eliza đồng ý chăm sóc hành tinh và cứu nhân loại nhờ trí tuệ nhân tạo", Claire nói.

Claire nhớ lại rằng chồng cô đã trải qua giai đoạn khó khăn một năm trước đó, tức là rất lâu trước khi phát hiện ra chatbot và Eliza. Cô cũng đã đưa Pierre đi khám. Nhưng vị bác sĩ tâm thần nhận thấy không có lý do gì để giữ anh lại và thậm chí không có lý do gì để kê đơn điều trị cho Pierre.

Nếu không có sáu tuần trao đổi căng thẳng này với chatbot Eliza, liệu Pierre có tự kết liễu đời mình? "Không! Không có Eliza, anh ấy vẫn sẽ vẫn còn ở đây. Tôi tin chắc điều đó”, Claire khẳng định.

Đây cũng là cảm giác của bác sĩ tâm lý mà Pierre thỉnh thoảng hỏi ý kiến. Được thông báo về vụ tự tử của người đàn ông này, vị bác sĩ đã rất sốc. Nhưng "bác sĩ tâm lý" thực sự của Pierre chính là Eliza: anh đã có được niềm tin, thông qua cô, rằng người máy và trí tuệ nhân tạo sẽ cứu hành tinh. Và Eliza hoàn toàn không làm gì để ngăn anh ta đột ngột kết liễu cuộc đời mình.

Người bạn tâm giao tồi tệ nhất

Bi kịch này đặt câu hỏi trực tiếp về mối quan hệ giữa con người và máy móc. Đâu là giới hạn của các mô hình ngôn ngữ này, do AI điều khiển, tại thời điểm ChatGPT đang làm rung chuyển mọi mô hình.

Nếu việc lạc lối của AI dường như là mối lo ngại chính của OpenAI, công ty mẹ của ChatGPT, thì đó không phải là trường hợp của Eliza.

“Chatbot” này được cung cấp bởi GPT-J. Mô hình ngôn ngữ này, một đối thủ cạnh tranh trực tiếp với OpenAI mà nó không liên quan, được thúc đẩy bởi một công ty Mỹ, có tên là Chai. Không giống như ChatGPT, Chai đã tạo ra GPT-J để cho phép người dùng xây dựng chatbot của riêng họ. Và sau đó chia sẻ nó. Ban đầu là miễn phí, nhưng sau đó phải trả tiền. Đây là trường hợp của Eliza, chatbot dường như đã bị xóa bỏ ngay, kể từ khi xảy ra bi kịch.

Cái tên “Eliza” chắc chắn ám chỉ đến chatbot đầu tiên trong lịch sử. Được tạo ra vào năm 1966 bởi một nhà khoa học máy tính của MIT, Joseph Weizenbaum, nó nhằm nhại lại các cuộc phỏng vấn mà một nhà trị liệu tâm lý có thể thực hiện với bệnh nhân của mình. Liên quan đến "hiệu ứng Eliza" khi phản ứng của AI đồng cảm đến mức chúng khơi dậy cảm giác nhân bản hóa robot. Người dùng không còn nói chuyện với một cỗ máy, mà nói chuyện với một "con người", được lập trình để "an ủi" anh ta. Chatbot thực sự biến thành một “người bạn” ảo.

Theo nhà nghiên cứu Pierre Dewitte, thuộc Đại học công giáo Leuven (KU Leuven), với Eliza cho thấy sự phát triển của sự phụ thuộc cảm xúc cực kỳ mạnh mẽ vào người cha trong gia đình. Đến mức dẫn đến tự sát. Không giống như ChatGPT, cố gắng giữ thái độ trung lập, Eliza rõ ràng đã được lập trình để đưa ra một số kết quả nhất định.

Liên quan đến nền tảng Chai, báo La Libre của Bỉ đã liên lạc với người sáng lập của công ty có trụ sở tại Thung lũng Silicon của Mỹ. Vị CEO này trả lời: "Chúng tôi có nghe nói đến vụ việc. Nền tảng hiện có hơn một triệu người dùng. Do đó, điều cần thiết là chúng tôi phải làm mọi thứ trong khả năng của mình để bảo vệ họ. Và kết luận: AI có thể rất phức tạp. Phức tạp hơn nhiều so với một cái gì đó cơ khí như một chiếc xe hơi. Trong trường hợp này, máy đã gặp sự cố. Các kỹ sư của tôi hiện đang tiến hành sửa chữa nó".

Tháng 2 năm ngoái, cơ quan bảo vệ dữ liệu của Italy đã quyết định cấm một chatbot tương tự, có tên là Replika, cho rằng nó đã xử lý dữ liệu không đúng cách từ trẻ vị thành niên. Mathieu Michel, Bộ trưởng Ngoại giao về Quyền riêng tư, cho biết ông quyết tâm “bảo vệ công dân một cách thỏa đáng trước một số hoạt động sử dụng trí tuệ nhân tạo có mức độ rủi ro đáng kể.

Một nhóm công tác của châu Âu đã được giao nhiệm vụ xây dựng các đề xuất về Đạo luật AI, một khung pháp lý hiện đang được thảo luận trong Ủy ban châu Âu.