Năm 2025 đánh dấu bước ngoặt của trí tuệ nhân tạo khi công nghệ “text-to-video” bước vào giai đoạn thương mại hóa toàn cầu. Tuy nhiên, cùng với sự bùng nổ sáng tạo, công cụ trí tuệ nhân tạo (AI) tạo video cũng mở ra mặt tối - nơi ranh giới giữa sáng tạo và tội phạm ngày càng mờ nhạt.

Bước tiến công nghệ mới

Sự xuất hiện của các mô hình tạo video bằng AI như Sora (OpenAI), Veo (Google) hay Runway Gen-3 đang tạo nên một “cuộc đua vũ bão” trong ngành công nghệ toàn cầu. Đây là giai đoạn mà trí tuệ nhân tạo không chỉ hiểu ngôn ngữ, mà còn biết “nhìn” và “tái hiện” thế giới qua hình ảnh động - từ vài dòng mô tả có thể dựng nên cả một đoạn phim sống động, chân thực như quay thật.

Theo OpenAI, Sora 2 có thể mô phỏng ánh sáng, chuyển động và tương tác vật lý chính xác đến mức gần như không thể phân biệt thật, giả. Runway Gen-3 Alpha lại mang đến khả năng tùy chỉnh khung hình, góc quay, chuyển cảnh theo ý đồ sáng tạo; trong khi Veo 3 của Google khai thác lợi thế hệ sinh thái Gemini để kết nối dữ liệu, âm thanh và hình ảnh thành sản phẩm đồng bộ, phù hợp doanh nghiệp sáng tạo.

Từ ba hướng tiếp cận khác nhau phản ánh, cả ba nền tảng này thể thiện các chiến lược: OpenAI hướng đến phổ cập công nghệ sáng tạo cho người dùng đại chúng. Google tập trung vào phân khúc doanh nghiệp và sản xuất nội dung chuyên nghiệp. Runway giữ vị thế công cụ sáng tạo chuyên sâu, đề cao tính minh bạch và quyền kiểm soát nội dung.

Tại Đông Nam Á, việc OpenAI chọn ra mắt Sora tại Việt Nam, Thái Lan và Đài Loan cho thấy khu vực này đang trở thành “điểm nóng” mới của sáng tạo số. Việt Nam được đánh giá là một trong những cộng đồng sáng tạo video năng động nhất châu Á, đặc biệt trong mảng video ngắn, truyền thông kỹ thuật số và marketing sáng tạo.

Sự xuất hiện liên tiếp của Sora (OpenAI), Gemini/Veo (Google) và Runway Gen-3 đang tạo nên một mặt trận cạnh tranh mới. Ảnh minh họa

Sự xuất hiện liên tiếp của Sora (OpenAI), Gemini/Veo (Google) và Runway Gen-3 đang tạo nên một mặt trận cạnh tranh mới. Ảnh minh họa

Lợi ích của video AI là không thể phủ nhận, đó là giảm chi phí sản xuất, mở rộng khả năng kể chuyện hình ảnh và giúp cá nhân, doanh nghiệp tạo nội dung nhanh hơn, cá nhân hóa hơn. Trong quảng cáo, giáo dục, truyền thông và phim ảnh, AI đang giúp biến những ý tưởng từng tốn hàng chục triệu USD sản xuất thành những video chỉ cần vài phút xử lý trên nền tảng điện toán đám mây.

Tuy nhiên, đằng sau tốc độ phát triển thần tốc ấy, một mặt trái khác cũng đang hình thành - nơi ranh giới giữa sáng tạo hợp pháp và hành vi vi phạm đạo đức, thậm chí tội phạm, trở nên mong manh hơn bao giờ hết.

Khi sáng tạo chạm ranh tội phạm

Công nghệ video AI đang mở ra cơ hội, nhưng cũng khiến xã hội đối mặt với nguy cơ lừa đảo và xâm phạm danh tính nghiêm trọng. Tại Việt Nam, chỉ trong 8 tháng năm 2025, hơn 1.500 vụ lừa đảo trực tuyến đã được ghi nhận, gây thiệt hại khoảng 1.660 tỷ đồng. Đây là ghi nhận của Cục An ninh mạng và Phòng, chống tội phạm sử dụng công nghệ cao (A05 - Bộ Công an).

Công an tỉnh Nghệ An đăng tải clip tuyên truyền trên Facebook, cảnh báo người dân về thủ đoạn tội phạm mạng sử dụng công nghệ AI tạo video giả mạo ca sĩ Mỹ Tâm để kêu gọi mở gian hàng “Amazon” - thực chất là chiêu lừa đảo trực tuyến. Ảnh chụp màn hình

Công an tỉnh Nghệ An đăng tải clip tuyên truyền trên Facebook, cảnh báo người dân về thủ đoạn tội phạm mạng sử dụng công nghệ AI tạo video giả mạo ca sĩ Mỹ Tâm để kêu gọi mở gian hàng “Amazon” - thực chất là chiêu lừa đảo trực tuyến. Ảnh chụp màn hình

Một trong những thủ đoạn phổ biến là Deepfake - công nghệ giả mạo hình ảnh, giọng nói người thật bằng AI. Chỉ cần vài chục giây ghi âm hoặc một tấm ảnh, kẻ gian có thể dựng nên video mạo danh nghệ sĩ, lãnh đạo hoặc người thân nhằm chiếm đoạt tài sản. Nhiều vụ việc đã được ghi nhận khi tội phạm sử dụng video AI giả mạo ca sĩ Mỹ Tâm, Hòa Minzy, Trấn Thành, Lý Hải để mời gọi đầu tư, mở gian hàng “Amazon quốc tế” hoặc quảng bá sản phẩm giả mạo.

Những video này được lan truyền trên các nền tảng mạng xã hội kèm lời giới thiệu hấp dẫn, giọng nói và cử chỉ giống hệt người thật, khiến người xem dễ tin tưởng. Các kịch bản lừa đảo thường được dàn dựng tinh vi, ban đầu “chim mồi” đặt hàng thật để tạo niềm tin, sau đó nạn nhân bị dẫn dụ đầu tư lớn, chuyển tiền cho “kho hàng” giả mạo và mất trắng. Không chỉ vậy, các video Deepfake còn bị lợi dụng để quảng cáo cờ bạc online, thuốc và mỹ phẩm không rõ nguồn gốc hoặc kêu gọi “hợp tác kinh doanh” dưới tên người nổi tiếng.

Theo các chuyên gia an ninh mạng, tội phạm công nghệ cao đang lợi dụng AI để giả giọng nói, giả hình ảnh người nổi tiếng hoặc cán bộ nhà nước nhằm chiếm đoạt tài sản. Hậu quả không chỉ là thiệt hại tài chính mà còn xói mòn niềm tin xã hội, khi người dân dần mất khả năng phân biệt thật, giả trong thế giới số.

Mặc dù các cơ quan chức năng đã nhiều lần cảnh báo, nhiều người vẫn bị mắc bẫy vì video ngày càng giống thật. Với sự phát triển nhanh của công nghệ tạo video AI như Veo 3 hay Sora 2, vấn đề này trở thành điểm nóng an ninh mạng. Các đối tượng lừa đảo giờ có thể dựng video chỉ trong vài phút, với ánh sáng, khẩu hình và biểu cảm gần như thật.

Do đó, Công an các tỉnh, trong đó có Nghệ An, TP Hồ Chí Minh và Hà Nội đang đẩy mạnh tuyên truyền cảnh giác qua các video ngắn, infographic và clip mô phỏng tình huống thực tế trên mạng xã hội để người dân dễ tiếp cận hơn.

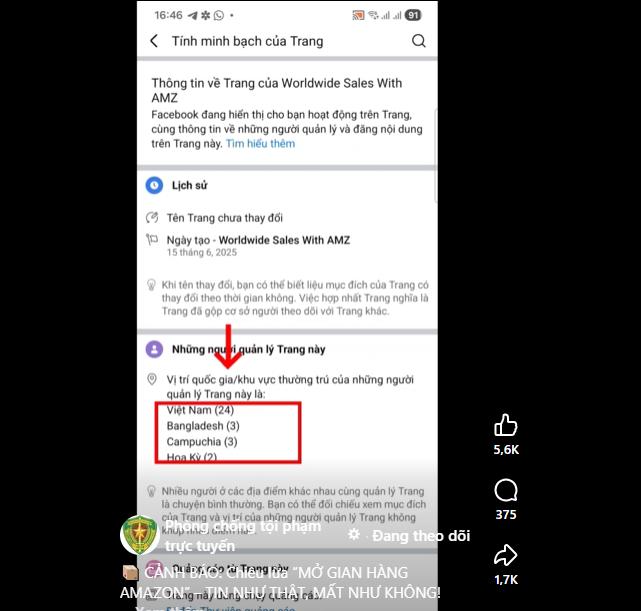

Trên trang “Phòng chống tội phạm trực tuyến”, Công an tỉnh Nghệ An hướng dẫn người dân cách nhận biết trang Facebook giả mạo bằng cách vào mục “Giới thiệu” và chọn “Tính minh bạch của Trang” để xem vị trí của người quản lý. Những khu vực được đánh dấu đỏ trên ảnh cho thấy nơi cư trú của các đối tượng tội phạm mạng xuyên quốc gia. Ảnh chụp màn hình

Trên trang “Phòng chống tội phạm trực tuyến”, Công an tỉnh Nghệ An hướng dẫn người dân cách nhận biết trang Facebook giả mạo bằng cách vào mục “Giới thiệu” và chọn “Tính minh bạch của Trang” để xem vị trí của người quản lý. Những khu vực được đánh dấu đỏ trên ảnh cho thấy nơi cư trú của các đối tượng tội phạm mạng xuyên quốc gia. Ảnh chụp màn hình

Công an Nghệ An đặc biệt cảnh báo: “Điều nguy hiểm nhất không chỉ là mất tiền mà là sự xói mòn lòng tin trên không gian mạng”. Cơ quan này hướng dẫn người dân nhận diện Deepfake qua các dấu hiệu đặc trưng như khuôn mặt ít biểu cảm, giọng nói chập chờn, lý do “sóng yếu”, yêu cầu chuyển tiền khẩn cấp hoặc tài khoản lạ. Những khuyến nghị này được chia sẻ rộng rãi trên Facebook, Zalo và YouTube, trở thành hình thức truyền thông phòng chống hiệu quả trong cộng đồng.

Trước diễn biến phức tạp, các nền tảng như OpenAI, Google, Runway đang thử nghiệm biện pháp kỹ thuật, đó là xác minh danh tính, chèn watermark động, áp dụng chuẩn C2PA để truy vết nguồn video. Tuy nhiên, giới chuyên môn nhận định, giáo dục kỹ năng số và hoàn thiện khung pháp lý mới là giải pháp bền vững. Hiện Luật An ninh mạng 2018 và Luật An toàn thông tin 2015 vẫn thiếu điều khoản cụ thể xử lý hành vi dùng AI để tạo Deepfake mạo danh.

Các đại biểu Quốc hội đã đề xuất bổ sung quy định cấm sử dụng AI hoặc Deepfake để giả mạo cá nhân, tổ chức, phát tán thông tin sai lệch hoặc lừa đảo, nhằm thiết lập ranh giới pháp lý rõ ràng cho kỷ nguyên video AI.

Không thể phủ nhận, công nghệ video AI là bước tiến vĩ đại, nhưng nếu không được quản trị chặt chẽ, nó có thể trở thành công cụ phạm tội. Do đó, muốn tận dụng sức mạnh sáng tạo mà vẫn bảo vệ giá trị con người, xã hội cần song hành công nghệ - pháp luật - đạo đức, để AI trở thành “đồng minh của sáng tạo” chứ không là mối đe dọa của niềm tin số.